En una búsqueda en Google scholar de artículos con el tema “artificial intelligence and theology”, aun limitándose al año 2023, la lista de resultados ocupa varias páginas, aunque es verdad que no todos los resultados son igualmente pertinentes.

Ética y antropología

Muchos de ellos, de forma bastante previsible, se enfocan en temas de carácter ético y antropológico. La relevancia del tema en esos dos campos es comprensible, así como la intervinculación de ambos aspectos, ya que la mayor parte de la ética, y más específicamente de la moral cristiana, es antropocéntrica. O habría que precisar: es “todavía” antropocéntrica, ya que desde hace tiempo van ganando espacio modelos no recíprocos de ética, en los que se acentúa la responsabilidad del ser humano hacia el mundo de lo no humano, como los derechos de los animales o la protección de la naturaleza sin limitarse a las condiciones de habitabilidad para el hombre, yendo más allá del significado etimológico de la palabra “ecología”.

Hace muchos años, en el programa televisivo de José María Íñigo, un humorista -quizá fuera Chumy Chúmez, pero es un recuerdo lejano y podría estar equivocado-, en plena moda de avistamientos extraterrestres, planteaba jocosamente, pero también seriamente, qué ocurriría si llegasen a nuestro planeta seres inteligentes con forma de vaca. ¿Sería ético tratarlos como alimento para nosotros?

La pregunta de por qué lo humano merece ser protegido tiene difícil respuesta. No pocas veces se incurre en un modo circular de argumentación, cuando se fundamenta en una inasible dignidad humana, que, a su vez, se justifica por la consideración del ser humano como término y beneficiario de la acción moral. Para salir de tal circularidad, se puede recurrir a una o varias características de los humanos, que lo encumbrarían por encima del resto de seres de la naturaleza. La carta triunfante ha sido con frecuencia la racionalidad: el ser humano es digno de ser tutelado en virtud de su condición de ser inteligente.

Ahora bien, esto plantea ulteriores problemas, de los cuales sólo enunciaremos unos pocos. De entrada, no hay un acuerdo en definir la inteligencia, y ni siquiera acerca de si es una cualidad exclusivamente humana. Superado el racionalismo cartesiano, así como el ilustrado, hoy sabemos que la inteligencia no es separable de la biología[1]. No hay un salto ontológico entre el animal autómata y el humano racional, sino que la racionalidad humana es también fruto de la evolución biológica; es un modo más complejo, pero homogéneo, de interacción con el medio. Si la inteligencia debe ser protegida, habría entonces que incluir en esa protección a los animales, al menos a aquellos que muestran capacidad de una interacción con nosotros que pueda considerarse al menos protointeligente. Por otra parte, hay humanos que no han logrado, temporal o definitivamente, un desarrollo de la inteligencia siquiera semejante al de un gran simio, por lo que sería menos destinatario de la atención ética general de lo que pueda serlo un bonobo o un chimpancé. Se podría llegar a la distopía de cuantificar la inteligencia como una magnitud mensurable que estableciese categorías entre humanos más o menos dignos.

En todo caso, ¿por qué motivo ha de ser la inteligencia el factor que debe ser protegido? Es un error pensar que la inteligencia es en exclusiva lo que nos constituye en humanos. La naturaleza humana está formada por distintos estratos, que no son capas superpuestas, sino aspectos emergentes (con todas las cautelas necesarias al emplear este término). Quizá para ver qué nos hace humanos, ayudaría ver qué hace que dejemos de serlo.

Habría que comenzar con el nivel ontológico: el ser humano existe. Es imposible adoptar una actitud de protección universal ante todo lo existente, por supuesto, pero hay que partir de ese dato. Toda forma de existencia creada es ontológicamente contingente, por lo que en este nivel podemos fijarnos en la fragilidad. La fragilidad no constituye un título de exigencia de preservación, desde luego, pero sí se encuentra en la base de su necesidad.

El siguiente nivel sería el biológico. La vida lleva en sí misma la muerte. A medida que se multiplican los cromosomas, sus telómeros se van acortando, hasta llegar a un punto en que la reproducción se vuelve imposible. La vida, al menos la basada en células eucariotas, tiene sus días contados. Ello no quiere decir que algún día la ciencia no pueda revertir este proceso (sin multiplicar incontroladamente los tumores), y algunos se muestran optimistas al respecto. Utilizando un símil extraído de los viajes extraorbitales, se habla de “velocidad de escape de la longevidad”, esperando alcanzar y superar un punto de inflexión crítico, de tal modo que la ciencia pueda acrecentar la duración de la vida humana a un ritmo superior al que se deteriora por naturaleza. Pero al menos por ahora, la muerte es un fenómeno natural asociado a la existencia de vida. Por otro lado, la vida es frágil. Infinidad de causas pueden acabar con ella: infecciones, malformaciones, traumatismos, lesiones… De nuevo, esto no constituye una justificación de por qué es éticamente necesario, o al menos conveniente, tutelar la vida humana. Pero nos orienta hacia el modo en que, si hubiese que hacerlo, habría que implementar medidas protectoras.

En tercer lugar, tenemos el plano sensitivo. Los seres vivos dotados de sensibilidad tienen una cierta percepción de la muerte. Pese al famoso epigrama de Erich Fried, un perro también sabe que muere (aunque no pueda decir que muere como un perro). Conocen y experimentan la muerte de los seres cercanos antes de presentir la propia. Esto convierte un hecho biológico en una experiencia vital, tanto más desgarradora cuanto más se asciende en la escala de la consciencia. Es en este plano de la sensibilidad donde se sitúa una franja importante del vegetarianismo éticamente motivado. Simplificando mucho, el argumento sería: hay que respetar o incluso proteger a todo ser con un sistema nervioso tal que le permita experimentar dolor y/o miedo; es decir, no dañar a quien pueda percibir el daño.

En la cima de la escala de la consciencia se encuentra el ser humano, cuya capacidad discursiva incluye la forja de proyectos, el establecimiento de relaciones complejas, la elaboración del estar bien de un modo global (el bienestar), las motivaciones razonadas, así como la capacidad para evaluar riesgos. Todas estas cosas, y otras más, contribuyen no sólo a que el hombre viva de forma coherente, sino tambin a que desee seguir viviendo para realizar sus proyectos y mantener sus relaciones. Cuando faltan las motivaciones (por razones clínicas o episódicas), o bien cuando el bienestar desaparece sin perspectivas de recuperación, así como cuando los riesgos aparezcan tales que cualquier salida implique dicha pérdida, puede eclipsarse la voluntad de vivir (suicidio, eutanasia…). Ahora bien, todas esas características del ser humano pueden darse, en alguna medida, también en otros animales. En concreto, Peter Singer distingue entre pertenecer a la especie humana y ser persona. Esto último dependería más bien de la posesión de una autoconciencia identitaria biográfica y una cierta autonomía, algo que se da en algunas especies animales, pero no en algunos humanos, por lo que, según él, habría que superar una ética especieísta para fijarse más bien en las personas, incluso en las no humanas[2]. Más allá de lo llamativo, o incluso escandaloso, que pueda ser el pensamiento de Singer, el conflicto de fondo se establece entre una ética basada en lo que el hombre es (como suele ser la moral cristiana) y una ética basada en algunas características que el hombre tiene.

Las personas forman parte de un sistema de relaciones complejas. Fue precisamente esto lo que propició la emergencia del homo sapiens tal como lo conocemos ahora: la creciente complejidad de las relaciones sociales propició el desarrollo del cerebro y viceversa. Ello significa que la muerte no afecta únicamente al sujeto que la padece, sino que representa también una cierta ruptura en quienes sienten a ese sujeto como parte de sus vidas. No es mera poesía expresar las ausencias (sean o no debidas a la muerte) como desgarros, ya que nuestras relaciones y afectos son tan parte de nosotros como nuestros ojos o nuestro corazón, aunque, por supuesto, sin la misma relevancia biológica. En este sentido tiene razón el Dr. House: “¿Sabes eso que dice la gente de que no puedes vivir sin amor? Bueno, pues el oxígeno es aún más importante”. Pero esto es verdad sólo en el plano biológico. No le falta razón a la sevillana: “algo se muere en el alma cuando un amigo se va”.

Además de los niveles ontológico, biológico, sensitivo, consciente-antropológico y social, podríamos señalar también una condición de unicidad-universalidad del hombre. En la película El sexto día, una empresa se dedica a hacer clones adultos (?) con discos de memoria que permiten transferir al clon todos los recuerdos (incluyendo la identidad) del sujeto fuente. Pero esto es ciencia ficción. Cada ser humano es un universo de experiencias, recuerdos, perspectivas, opiniones, valores y conocimientos únicos. Cuando un ser humano muere, todo ese universo desaparece con él. No es necesario haber visto, como Roy Batty, el replicante de Blade Runner, naves de combate en el hombro de Orión ni rayos-C cerca de la puerta de Tannhäuser. Todos esos conocimientos, al menos desde la perspectiva única de ese único sujeto, se perderán como lágrimas en la lluvia.

¿Puede la inteligencia artificial llegar algún día a decidir sobre la misma existencia de Dios?

Quizá ninguno de esos niveles por separado pueda justificar una ética antropocéntrica. Es más bien su conjunto lo que nos hace sensibles hacia un ser que es a la vez frágil y valioso. Cuando la moral cristiana basaba la dignidad humana en la idea de que el hombre ha sido creado a imagen de Dios, e interpretaba esto, sobre todo a partir de la escuela de Alejandría, centrándolo exclusiva o primordialmente en la racionalidad (entendimiento y voluntad) caía en un reduccionismo que despojaba al ser humano de muchas de sus dimensiones no estrictamente cognitivo-volitivas. Aquí está el error principal de quienes quieren ilustrar la diferencia entre cuerpo y alma con la que existe entre hardware y software, recayendo involuntariamente en un platonismo abierto a la reencarnación, frente al modelo aristotélico, asumido en parte por Tomás de Aquino (si bien con una buena dosis de platonismo él mismo), según el cual el alma se refiere al cuerpo de forma única en cuanto que realiza sus funciones vitales, sensitivas e intelectivas, inseparables, salvo la última, según Tomás, de ese cuerpo concreto. Pero incluso en Tomás, aunque el alma, en virtud de su facultad intelectiva pueda subsistir separada del cuerpo, no puede hacerlo sin haber existido antes como alma de un cuerpo individual y único.

Quizá ninguno de esos niveles por separado pueda justificar una ética antropocéntrica. Es más bien su conjunto lo que nos hace sensibles hacia un ser que es a la vez frágil y valioso. Cuando la moral cristiana basaba la dignidad humana en la idea de que el hombre ha sido creado a imagen de Dios, e interpretaba esto, sobre todo a partir de la escuela de Alejandría, centrándolo exclusiva o primordialmente en la racionalidad (entendimiento y voluntad) caía en un reduccionismo que despojaba al ser humano de muchas de sus dimensiones no estrictamente cognitivo-volitivas. Aquí está el error principal de quienes quieren ilustrar la diferencia entre cuerpo y alma con la que existe entre hardware y software, recayendo involuntariamente en un platonismo abierto a la reencarnación, frente al modelo aristotélico, asumido en parte por Tomás de Aquino (si bien con una buena dosis de platonismo él mismo), según el cual el alma se refiere al cuerpo de forma única en cuanto que realiza sus funciones vitales, sensitivas e intelectivas, inseparables, salvo la última, según Tomás, de ese cuerpo concreto. Pero incluso en Tomás, aunque el alma, en virtud de su facultad intelectiva pueda subsistir separada del cuerpo, no puede hacerlo sin haber existido antes como alma de un cuerpo individual y único.

Tanto la literatura como el cine de ciencia ficción han planteado conflictos éticos sólo allí donde las máquinas son no solamente inteligentes, sino intencionales y sensitivas, no necesariamente con sensibilidad física o táctil, pero sí capaces de sufrir por orgullo o frustración. Se podría decir que HAL 9000 actúa de acuerdo con su programación para proteger la misión, pero sus reacciones parecen demasiado humanas, hasta el punto de confesar al final que tiene miedo. De hecho, la actuación de HAL y sus reacciones aparentemente motivadas por orgullo, afán de supervivencia y miedo, son uno te los temas centrales de la película 2001. Una Odisea del espacio. Qué decir de los replicantes de Blade Runner, a los que se les somete a un test para ver si traicionan la ausencia de esa empatía que en principio se supone en los humanos, No hablemos de las sagas de Terminator y The Matrix, donde las máquinas entran en guerra con los hombres.

La inteligencia artificial de nuestros días está aún lejos de cumplir ese proyecto de Stanley Kubrick llevado a cabo por Steven Spielberg en la película A.I. No existen todavía máquinas que puedan superar satisfactoriamente el test de Turing. Incluso es discutible que ese test, por útil que pudiera ser, realmente nos permita afirmar algo esencialmente significativo a este respecto. Supongamos que llegamos a una máquina cuyas respuestas sean indistinguibles de las de un humano, con su mezcla de conocimiento e ignorancia, de intuición y falsas percepciones, de empatía positiva (altruismo) pero también negativa (malicia)… ¿podríamos decir que esa máquina es, al menos desde un punto de vista éticamente relevante, humana?

La respuesta no puede reducirse a una negación apriorística que parte de lo que quiere dilucidar: la IA nunca podrá ser ética, filosófica o teológicamente equiparable a lo humano porque ella misma no es humana. En un supuesto diverso, si se pudiesen transferir todas las experiencias y memorias cerebrales de un humano a una máquina, podría haber disputa sobre si tal máquina, al menos en la medida en que mantiene la integridad de tales memorias, debe ser respetada por aplicación de principios éticos. Pues bien, supongamos que se llega a construir un equivalente de experiencias y memorias, pero en este caso no a partir de un cerebro biológico previo, sino porque la propia máquina consigue imitar de forma razonablemente perfecta los mecanismos de aprehensión y tratamiento de datos de los humanos, ¿no nos encontraríamos ante un caso, si no igual, al menos desafiante en su semejanza?

¿Puede la IA “hacer” teología?

Fuera del terreno de la ética y la antropología, otro de los ámbitos en los que la teología puede estar interesada por la inteligencia artificial es el del propio modo de hacer teología. Por lo que respecta a la acumulación de datos, la teología se puede beneficiar de la inteligencia artificial como cualquier otra disciplina. Ya no es necesario ser un conocedor exhaustivo de la Biblia, los Padres o los concilios. Puede que pronto se vuelva anticuada aquella máxima de que lo importante no es saber, sino saber a quién preguntar. La inteligencia artificial podría incluso dispensarnos del conocimiento de la fuente de los recursos, pues ya los gestionaría ella. ¿Pero qué ocurre con la elaboración con sentido de tales datos? ¿Está el lector seguro de que el artículo que está leyendo no ha sido escrito por un chat de inteligencia artificial generativa?

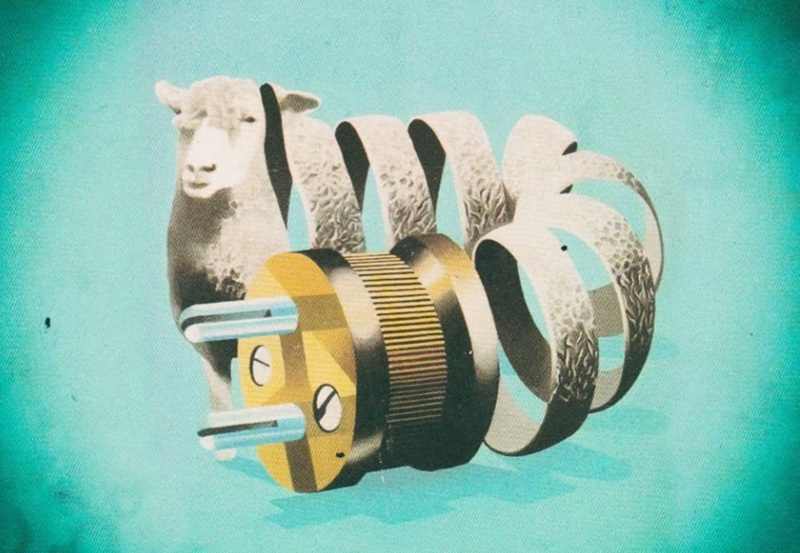

Philip K. Dick se preguntaba en 1968 si los androides sueñan con ovejas eléctricas, en el título de una de las más apreciadas novelas de ciencia ficción, que a su vez daría lugar a una película de culto: Blade Runner (1982). Hoy podríamos preguntarnos: ¿pueden los robots hacer teología?[3]

Distintas herramientas de IA han mostrado la capacidad de elaborar ensayos en los que muchas veces resulta imposible distinguir si han sido elaborados por un humano o por una máquina. En ciencias de corte histórico o empírico, basadas en el conocimiento de datos y su elaboración, esto quizá pueda resultar asombroso, pero comprensible. Más difícil sería imaginarnos una IA artificial haciendo filosofía especulativa. La filosofía es radicalmente humana, pues no se basa en el conocimiento, sino, en gran medida, en la experiencia de su limitación: nos preguntamos porque nos sabemos ignorantes.

La teología se puede beneficiar de la inteligencia artificial como cualquier otra disciplina. Ya no es necesario ser un conocedor exhaustivo de la Biblia, los Padres o los concilios. Puede que pronto se vuelva anticuada aquella máxima de que lo importante no es saber, sino saber a quién preguntar

La carencia también está en la base de la teología, como lo está en la base de la fe. La fe no se limita a lo cognitivo, pero en este aspecto es, por definición, no evidente y, por tanto, carente de las certezas que caracterizan a otras formas de conocimiento. Sin embargo, el cristianismo no entiende, por lo general, la fe como una actividad reducida a lo intelectual. A la fe subyacen, además, otro tipo de carencias más vitales, de orden económico, de poder o afectivo, en particular aquella que señala Agustín en el comienzo de sus Confesiones: “nos hiciste, Señor, para ti y nuestro corazón está inquieto hasta que repose en ti”. ¿Cómo transmitir tales experiencias a una máquina? ¿Pueden los androides creer en Dios? Para “creer” en el sentido apuntado, la inteligencia debe ser también emocional, cosa que no parece, al menos de momento, factible (y mucho menos deseable) en la IA.

Estas cuestiones están todavía muy lejos del alcance de la IA hoy disponible. Pero quizá no sea peregrina la pregunta siguiente: ¿puede la inteligencia artificial llegar algún día a decidir sobre la misma existencia de Dios? Frente al ruido mediático provocado tanto por los líderes del llamado “Nuevo Ateísmo” como por la nueva apologética teísta pseudocientífica, podría plantearse si el ejercicio de la pura racionalidad desapasionada estaría en condiciones de proporcionar pruebas de orden lógico, metafísico o científico al respecto. Como un inteligente Homer Simpson buscando un sistema para reducir los impuestos llegó accidentalmente a una demostración de la inexistencia de Dios que ni siquiera Ned Flanders pudo refutar, ¿podría la IA llegar a una prueba tan invencible, en ese sentido o en el contrario?

Decíamos antes que la fe presupone una carencia cognitiva. Pues bien, a este respecto, la pregunta sería si la carencia cognitiva implicada en la fe es de orden factual u ontológico. Dicho de otro modo, si la fe es cognitivamente limitada porque aún no se conocen argumentos irrefutables, en un sentido u otro, pero no sería imposible que los hubiese; o si por su misma naturaleza está más allá de las capacidades cognitivas en general, por lo que, incluso un razonamiento sin ningún tipo de límites o lagunas sería incapaz de llegar a una conclusión definitiva, por lo una decisión final al respecto sólo podría obtenerse en una situación que trascienda lo mundano, mediante una revelación sobrenatural incuestionable, presente o escatológica. En el primer caso, la IA podría llegar a alguna conclusión. No así en el segundo. E, incluso en el primer caso, habría que ver si la deficiencia cognitiva deriva de una disponibilidad insuficiente de datos o de algo que tal vez ni siquiera una máquina perfecta podría resolver: la decidibilidad de si disponemos de los datos y la capacidad de saber cuáles son los pasos necesarios para llegar a tal conclusión.

Pero por el momento esto es pura especulación. En el estado actual de las cosas, la IA no es, pese a las apariencias, una maquinaria que resuelva mágica y apodícticamente cualquier pregunta que se le pueda hacer. Y no podemos saber si eso sea siquiera realizable en el futuro. Pese al optimismo del matemático David Hilbert, tal vez haya que mantener el más realista “ignoramus et ignorabimus”.

Prof. Dr. Alfonso Novo Cid-Fuentes

Instituto Teológico Compostelano

[1] A. Damásio, El error de Descartes, La emoción, la razón y el cerebro humano, Crítica 2010.

[2] Peter Singer, Ética práctica, Akal 2009; R. Spaeman, “¿Es todo ser humano una persona?”, Persona y Derecho 33 (1997) 9-23; M. A. Polo Santillán, “Bioética y persona en Peter Singer”, Escritura y Pensamiento 7 (2004) 61-78.

[3] Cf. Marius Dorobantu, “Artificial Intelligence as a Testing Ground for Key Theological Questions”, Zygon 57 (2022) 984-999.